Tag: LLM

All the articles with the tag "LLM".

-

用 AI Agent 把自然语言转成 SQL:三种方案的实验对比

Published: at 02:00 AM微软 ISE 团队对比了 GitHub Copilot CLI、Microsoft Agent Framework 和 Azure Databricks AI/BI Genie 三种 NL-to-SQL 方案,在 LiveSQLBench 上进行系统实验。核心发现:运行时查询验证是准确率的命门,去掉后准确率从 76.92% 跌至 38.46%;领域提示(domain hints)能额外提升 14 个百分点;剩余 ~25% 的失败几乎都来自业务逻辑语义误解。

-

.NET AI 核心构建块:Microsoft.Extensions.AI 详解

Published: at 12:20 AM微软发布了面向 .NET 开发者的 AI 基础构建块系列,本文聚焦第一块:Microsoft.Extensions.AI(MEAI)。它提供统一的 LLM 访问接口,支持 OpenAI、OllamaSharp、Azure OpenAI 等多家提供商,并内置结构化输出、中间件、多模态内容等能力,是构建 .NET 智能应用的基础。

-

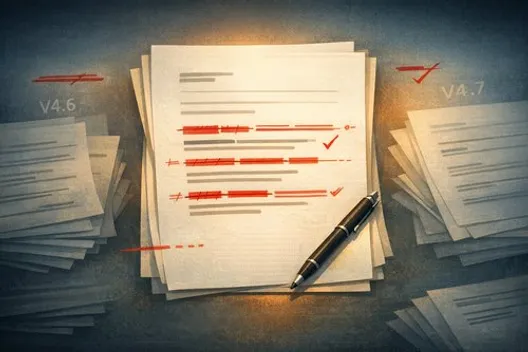

Claude Opus 4.7 系统提示词变化全解析

Published: at 01:02 AMAnthropic 是少数公开发布系统提示词的 AI 厂商。本文梳理 Claude Opus 4.6 到 4.7 系统提示词的核心变更,包括行动优先策略、tool_search 机制、内容安全扩充以及冗余措辞的清理。

-

把 LLM 当知识库编辑:Karpathy 的个人研究工作流

Published: at 03:40 AMAndrej Karpathy 分享了一套用 LLM 构建和维护个人研究知识库的完整方法:把原始文献编进 .md wiki,用 Obsidian 做前端,让 LLM 自主管理、查询和增强知识,而不依赖 RAG 或复杂向量数据库。

-

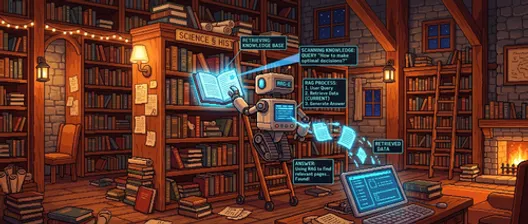

RAG 入门指南:在正确的时机用正确的方式构建检索增强生成系统

Published: at 12:27 AM本文基于 Daniil Shykhov 的 RAG 实战经验,聚焦三个问题:RAG 究竟是什么、你真的需要它吗、以及在哪些环节最容易出错。如果你曾被向量数据库和 embedding 模型的教程绕晕,从这里开始。

-

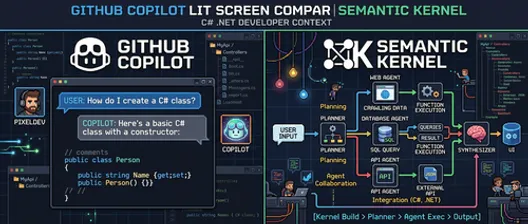

GitHub Copilot SDK 与 Semantic Kernel:C# 中如何选择

Published: at 02:20 AMGitHub Copilot SDK 和 Semantic Kernel 都能帮你在 C# 里构建 AI 功能,但它们解决的是完全不同的问题。本文对比两者的架构差异,给出实际代码示例和清晰的选择决策框架。

-

在编码 Agent 中使用 Git:从基础操作到历史重写

Published: at 02:00 AMSimon Willison 总结了如何配合 AI 编码 Agent 发挥 Git 的全部潜力——从常用提示词到撤销提交、bisect 调试、从旧仓库提取模块,让 Git 的高级功能对每个人都变得触手可及。

-

Agentic engineering 为什么离不开代码执行回路

Published: at 12:48 AMSimon Willison 这篇文章最值得记住的,不是又给 AI 起了一个新名字,而是把一个经常被说虚的概念说实了:所谓 agentic engineering,说到底就是让会写代码的模型还能自己跑代码、调工具、看结果,然后继续迭代。真正的分水岭不在提示词更花,而在软件开发终于接上了可执行、可验证的反馈回路。