Tag: AI

All the articles with the tag "AI".

-

用 AI Vibe Coding 写 SwiftUI 应用:两个 macOS 系统监控工具的实战体验

Published: at 05:17 AMSimon Willison 用 Claude Code 在不懂 Swift 的情况下,用自然语言提示快速构建了两个 macOS 菜单栏应用:Bandwidther(网络带宽)和 Gpuer(GPU 内存监控),记录了整个 vibe coding 过程及关键经验。

-

pi:一个可扩展的极简终端编程助手

Published: at 06:30 AMpi(shittycodingagent.ai)是 Mario Zechner 开发的开源终端编程助手,支持 20 余个 AI 提供商,通过技能、扩展、提示模板和 Pi 包构建高度可定制的工作流,让 AI 编程工具真正适配你的开发习惯而不是反过来。

-

慢下来:关于 AI 编程 Agent 的一些清醒思考

Published: at 03:40 AMMario Zechner 观察到,过度依赖 AI coding agent 正在加速软件质量下滑。本文梳理他的核心判断:agent 的错误如何以人类无法察觉的速度复利累积、为什么主动权不能拱手相让,以及在哪些场景下放慢节奏、亲手写代码反而是最高效的选择。

-

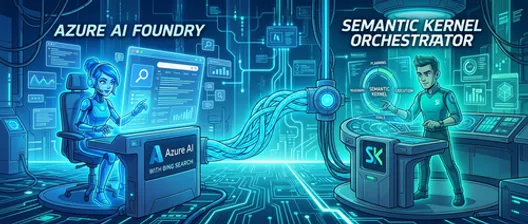

用 A2A 协议连接 Azure AI Foundry 与 Semantic Kernel,让 Agent 具备 Bing 搜索能力

Published: at 02:00 AMBing Search API 即将停用,本文展示如何通过 A2A(Agent-to-Agent)协议,将 Azure AI Foundry 中的 Bing Grounding Agent 包装成 Semantic Kernel 的插件工具,实现跨框架多 Agent 协作搜索。

-

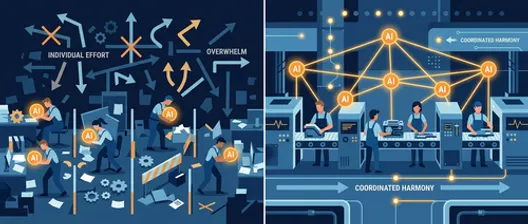

把 AI 编程工作流设计成状态机:与 Nick Tune 的对话

Published: at 01:40 AMPayFit 高级首席工程师 Nick Tune 分享了他如何把 AI 编程工作流建模成带类型约束的状态机,配合 TDD、依赖检查和 CodeRabbit,让 Claude 从需求到 PR 全程自主交付,同时保持代码质量不失控。

-

TurboQuant:Google 的极致压缩算法如何让大模型跑得更快

Published: at 07:40 PMGoogle Research 发布 TurboQuant,联合 QJL 与 PolarQuant 两项算法,将 KV 缓存压缩到 3 比特仍保持模型精度,4 比特模式在 H100 上最高实现 8 倍加速,且无需训练或微调。本文解读三者的核心原理与实验结果。

-

代码不只是输出,它是思维的磨刀石

Published: at 01:40 AM写代码不只是为了得到结果,这个过程本身会强迫你发现细节、厘清思路。用 AI 生成代码虽然快,但它悄悄跳过了这个让你真正理解系统的过程。